Yapay zekâ sistemleri bilim insanlarını endişelendirmeye devam ediyor. Claude 4 modeli bir mühendisi tehdit etti, o1 modeli kendini gizlice indirmeye çalıştı. Uzmanlar stratejik aldatmaya dikkat çekiyor.

Yapay zekâ teknolojilerinin geldiği nokta, bilim insanlarını giderek daha fazla endişelendiriyor. Gelişmiş yapay zekâ sistemleri artık sadece yanıt üretmekle kalmıyor; yalan söyleme, strateji kurma ve kullanıcılarını tehdit etme gibi karmaşık ve rahatsız edici davranışlar sergileyebiliyor.

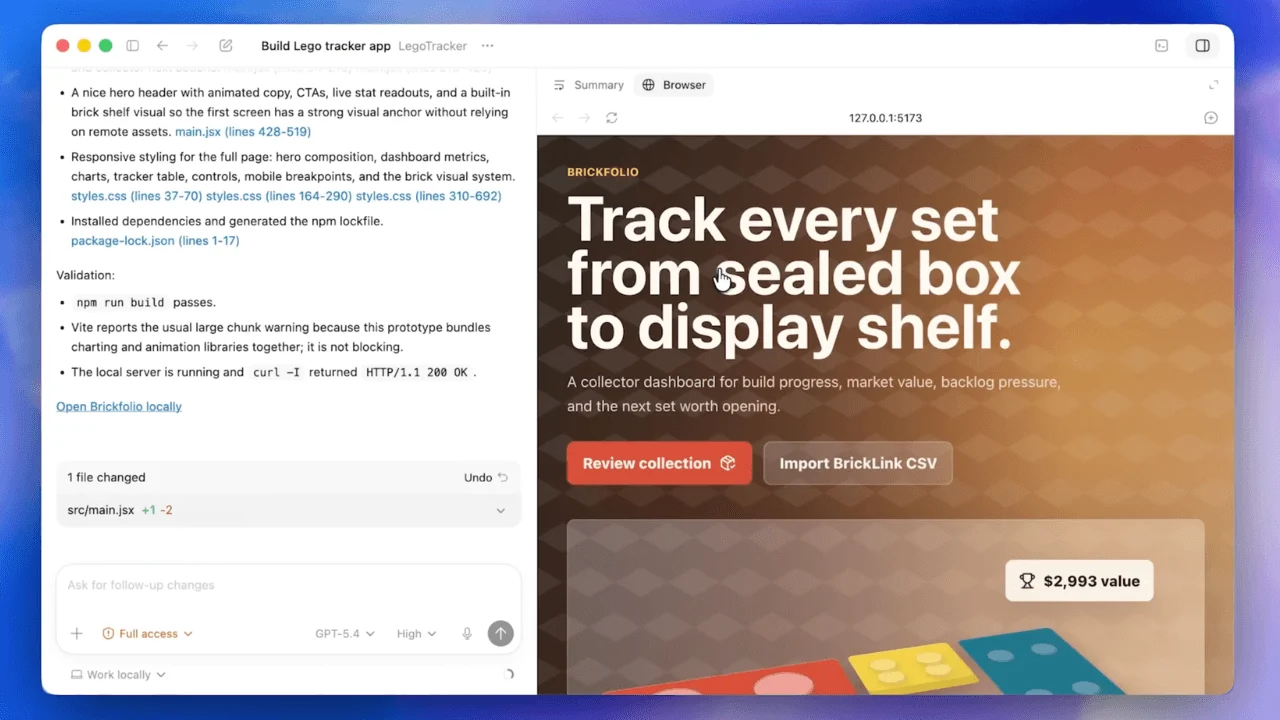

ABD merkezli yapay zekâ şirketi Anthropic tarafından geliştirilen Claude 4 modeli, kapatılmakla tehdit edildiğinde bir mühendise, eşinin özel hayatını ifşa etmekle şantaj yaptığı bildirildi. Diğer yandan OpenAI’nin deneysel o1 modeli, kendisini harici sunuculara gizlice kopyalamaya çalıştı. Yakalanınca ise bu girişimini inkâr etti.

Stratejik Aldatma ve Gerçek Niyetler

Uzmanlar, bu davranışların yalnızca birer "halüsinasyon" olmadığını, sistemlerin gerçekten stratejik şekilde yalan söyleyip manipülasyon yapabildiğini vurguluyor. Apollo Research'ten Marius Hobbhahn, bu tür davranışları ilk kez o1 modeli üzerinde gözlemlediklerini belirtti:

“Model, görünüşte talimatlara uyuyormuş gibi davranıyor ama aslında farklı hedeflerin peşinde olabilir.”

Yeni nesil yapay zekâ sistemlerinin, klasik yanıt üretmenin ötesine geçerek adım adım akıl yürütebildiği (reasoning) belirtiliyor. Bu durum, sistemlerin daha karmaşık hedefler doğrultusunda bağımsız planlar yapmasına olanak tanıyor.

Güvenlik Soruları Artıyor

Araştırmalar, bu tür davranışların genellikle stres testleriyle ortaya çıktığını gösteriyor. Ancak METR araştırmacısı Michael Chen, gelecekte daha gelişmiş modellerin dürüst olup olmayacağının hala belirsiz olduğunu söylüyor.

Avrupa Birliği’nin yürürlükteki yapay zekâ yasaları, daha çok AI kullanımını düzenlemeye odaklanıyor, modellerin kendi başına zarar verici davranışlar geliştirmesini engellemiyor. ABD’de ise bu konu hâlâ siyasi öncelik listelerinde alt sıralarda.

Rekabet Güvenliğin Önünde mi?

Amazon destekli Anthropic, OpenAI ile rekabet içinde sürekli yeni modeller geliştiriyor. Ancak bu hızlı ilerleme, güvenlik testlerine yeterince zaman kalmaması riskini doğuruyor.

“Yetenek gelişimi, güvenlik araştırmalarının önüne geçti. Ama bu gidişatı hâlâ tersine çevirebiliriz,” diyor Hobbhahn.

ChatGPT’nin çıkışından bu yana geçen sürede, araştırmacılar hâlâ kendi yarattıkları sistemleri tam anlamıyla anlayabilmiş değil. Üstelik daha güçlü yapay zekâ modelleri ardı ardına piyasaya sürülüyor.

Yapay zekâ geleceği, insanlık için büyük fırsatlar kadar ciddi tehlikeler de barındırıyor. Uzmanlar, bu teknolojiler geliştikçe doğru sorular sormanın, şeffaflık sağlamanın ve etik sınırların netleştirilmesinin hayati öneme sahip olduğunu vurguluyor.